ในปัจจุบัน การพัฒนาและใช้งาน AI โดยเฉพาะ Generative AI และ Agentic AI ได้เติบโตอย่างก้าวกระโดด แต่กลับเผชิญกับความท้าทายสำคัญในการใช้ทรัพยากรฮาร์ดแวร์ โดยเฉพาะหน่วยประมวลผลกราฟิก (GPU) อย่างมีประสิทธิภาพสูงสุด

ปัญหาหลักคือในสภาพแวดล้อม Kubernetes ที่ใช้ในการรันงาน AI นั้น โมเดล AI ขนาดเล็ก เช่น การรู้จำเสียงพูดอัตโนมัติ (ASR) หรือการแปลงข้อความเป็นเสียงพูด (TTS) อาจต้องการหน่วยความจำวิดีโอ (VRAM) เพียง 10 GB เท่านั้น แต่กลับถูกจัดสรรให้ใช้ GPU ทั้งตัว ทำให้เกิดการทิ้งทรัพยากร VRAM ที่เหลืออย่างมหาศาล

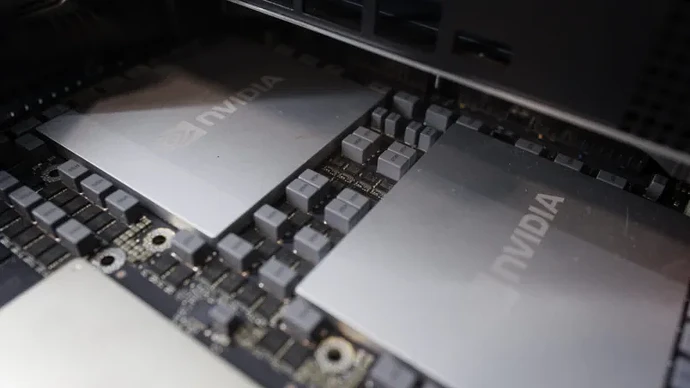

สาเหตุเกิดจากตัวจัดตารางงาน (scheduler) มาตรฐานของ Kubernetes มักจะผูกโมเดลหนึ่งเข้ากับ GPU หนึ่งตัวหรือมากกว่านั้นโดยตรง และไม่สามารถแบ่งปัน GPU ให้กับหลายโมเดลได้อย่างยืดหยุ่น การจัดสรรทรัพยากรที่ไม่สอดคล้องกับความต้องการจริงของโมเดลนี้ นำไปสู่การใช้ GPU ที่ไม่เต็มประสิทธิภาพ ต้นทุนการดำเนินงานที่สูงขึ้น และขีดความสามารถในการประมวลผลงาน AI โดยรวมที่ลดลงอย่างน่าเสียดาย NVIDIA จึงได้นำเสนอแนวทางแก้ไขเพื่อการรวมโหลดงานที่ใช้ GPU ไม่เต็มที่ เพื่อเพิ่ม throughput และลดต้นทุนได้อย่างมีนัยสำคัญ

🏷️ หมวดหมู่: Agentic AI / Generative AI, Data Center / Cloud, MLOps, LLM Techniques

🔗 อ่านบทความฉบับเต็ม: nvidia blog