GPU สำหรับศูนย์ข้อมูลระดับเรือธงของ NVIDIA อาทิ ตระกูล Ampere, Hopper และ Blackwell ต่างมีพฤติกรรมการเข้าถึงหน่วยความจำแบบ Non-Uniform Memory Access (NUMA) ซึ่งหมายความว่า GPU อาจเข้าถึงหน่วยความจำบางส่วนได้เร็วกว่าส่วนอื่นๆ แม้ว่าโดยปกติแล้ว โปรแกรมส่วนใหญ่จะทำงานได้โดยไม่มีปัญหา เนื่องจาก GPU มักจะแสดงพื้นที่หน่วยความจำออกมาเป็นแบบเดียว

ทว่า ในยุคที่แบนด์วิดท์หน่วยความจำของ GPU มีความเร็วสูงขึ้นอย่างต่อเนื่อง NVIDIA ได้เล็งเห็นถึงโอกาสสำคัญในการเพิ่มประสิทธิภาพและประหยัดพลังงานอย่างมาก ด้วยการใช้ประโยชน์จากความไม่สม่ำเสมอของการเข้าถึงหน่วยความจำแบบ NUMA นี้อย่างชาญฉลาด

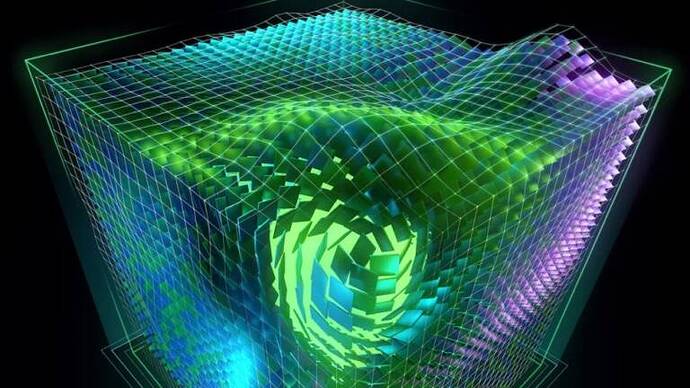

เทคนิคที่ NVIDIA นำเสนอคือการใช้ Multi-Instance GPU (MIG) ร่วมกับการจัดตำแหน่ง NUMA Node (NUMA Node Localization) โดย MIG ช่วยให้ GPU สามารถแบ่งทรัพยากรออกเป็นส่วนย่อยๆ หลายส่วนได้อย่างอิสระ ในขณะที่ NUMA Node Localization จะจัดสรรและจัดระเบียบการเข้าถึงหน่วยความจำให้แต่ละส่วนประมวลผลได้อย่างมีประสิทธิภาพสูงสุด เทคโนโลยีนี้จึงเป็นกุญแจสำคัญในการปลดล็อกศักยภาพสูงสุดของ GPU สำหรับงานประมวลผลข้อมูลขนาดใหญ่และซับซ้อน

🏷️ หมวดหมู่: Agentic AI / Generative AI, Data Center / Cloud, Simulation / Modeling / Design, CUDA C++, Data Analytics / Processing, featured, Memory, Multi-Instance GPU (MIG)

🔗 อ่านบทความฉบับเต็ม: nvidia blog